LLMO(大規模言語モデル最適化)とは?SEOとの違い・導入方法・最新トレンド

目次

AIの急速な進歩が、Webマーケティングの常識を根底から覆しつつあります。

これまで人が検索し、人が読むことを前提としていたWebの世界。それが現在では、AIが情報を収集・要約し、最適な回答を提示する時代となりました。

従来のSEOだけでは通用しない、そんな時代の到来を象徴するのが「LLMO(Large Language Model Optimization)」です。

AIという新たな「読者」を攻略すること。それこそが、これからの企業サイトやブランドに要求される必須スキルとなっています。

本記事では、AI時代に欠かせない「LLMO」について、SEOとの違いや導入ステップ、最新トレンドまでを実践的に解説します。

- LLMO(大規模言語モデル最適化)の定義とSEOとの違い

- AI時代にLLMOがなぜ求められるのか

- LLMOの基本的な仕組みと具体的な対策

LLMOとは何か?

昨今、情報の「届き方」が劇的に変化しています。

AIが日常的に情報を収集・要約し、ユーザーの手元に届ける時代に突入したのです。

この流れの中で登場したのが「LLMO(Large Language Model Optimization:大規模言語モデル最適化)」です。

LLMOは、AIに自社のコンテンツを正確に理解させ、信頼性のある情報として推薦されるための最適化手法です。

この最適化を行うことで、企業は自社のコンテンツをAIに適した形で提供し、AIがユーザーに有用な情報として届けることができます。

LLMOは単なる流行語ではなく、このようなAIを前提とした情報設計がすでに企業の競争力そのものを左右し始めています。

LLMO(Large Language Model Optimization)の定義と意味

LLMOとは、ChatGPTやGeminiのような大規模言語モデル(AI)に自社のWebサイトやコンテンツを正しく理解させ、信頼できる情報源として引用・推薦してもらうための最適化手法です。

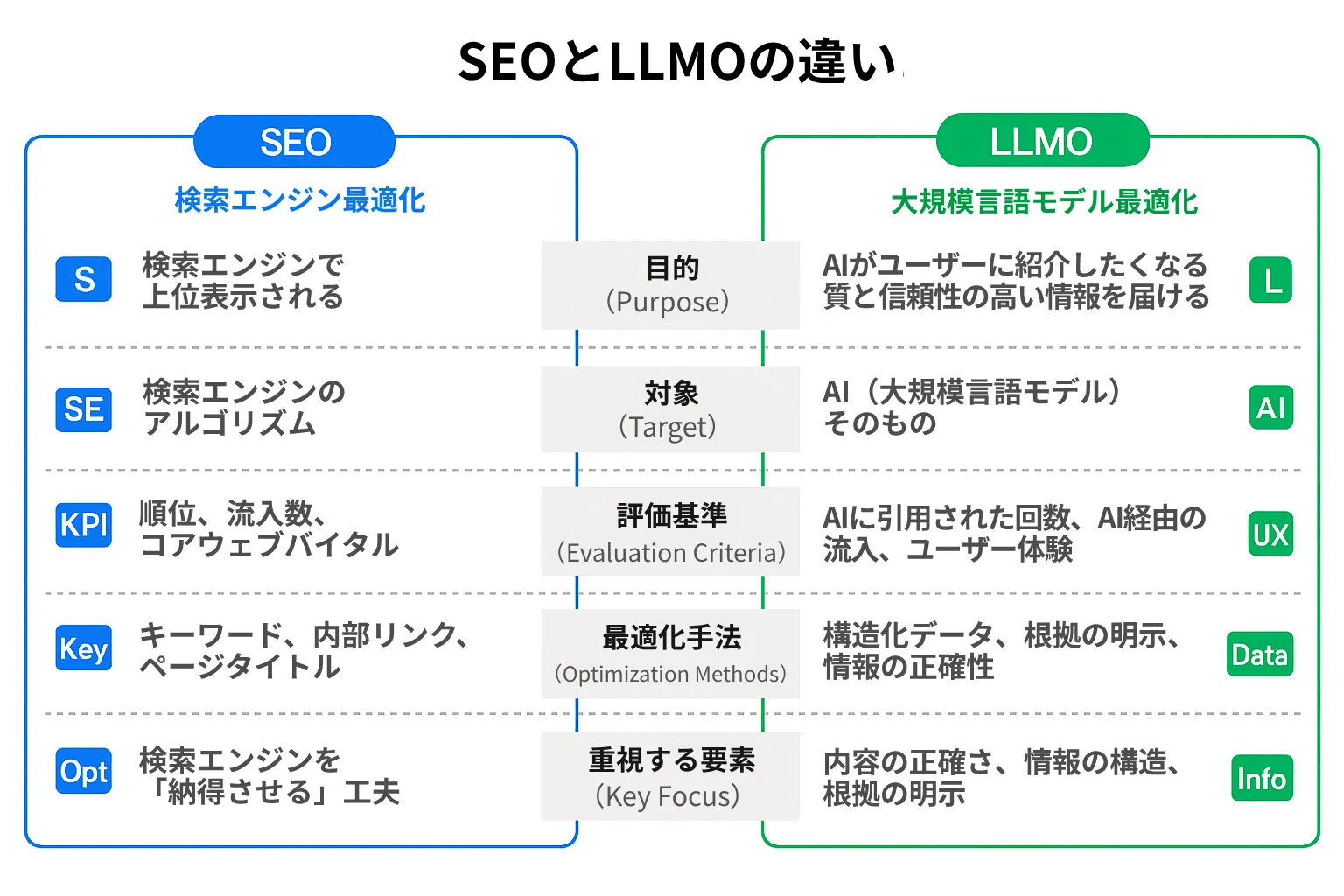

従来のSEOが「検索エンジンで上位表示される」ことを目指すのに対し、LLMOは「AI自身がユーザーに紹介したくなる“質と信頼性の高い情報”を届ける」ための考え方です。

AI時代の情報発信では、「誰が書き、どのような根拠があり、どのような構造でまとめられているか」が今まで以上に重要視されています。

現在のAIは、単純なキーワードマッチングから、より高度な内容理解へと進化を続けています。

実際に、「Stanford HAI AI Index Report 2025」によると、AI システムの事実性や安全性を評価する新しいベンチマークである「HELM Safety」「AIR-Bench」「FACTS」などが開発されており、AIがより正確で信頼できる情報を提供できるよう評価技術が向上中とのことです。

今後の情報発信は、LLMOの観点抜きには語れません。ただし、LLMOの厳密な国際定義や公式ガイドラインは、現時点ではまだ存在しません。

それでも、最先端の論文や現場での取り組みを通じて「AIに届く情報設計」のノウハウが急速に蓄積されています。

なぜ今、LLMOが求められるのか

AIがユーザーの「調べもの」や「意思決定」に積極的に使われるようになったことで、情報が人に届く仕組み自体が大きく変化しています。

今は、GoogleのAI Overviews(日本語名:AIによる概要)やChatGPTのようなAIが、インターネット上の膨大な情報の中から「信頼できる答え」を自動でまとめてユーザーに提供する時代です。

このため「AIに選ばれ、AIを通じてユーザーに情報を届けてもらう」ための準備=LLMOが、どの企業サイトにも欠かせません。

Googleは2025年5月時点でAI Overviewsを200か国以上に拡大し、月間15億人超のユーザーが利用しています。

このAI検索の普及は、従来の「順位狙い」のみのSEOでは、情報がユーザーに届きにくい時代になったことを示しています。

広告やビジネスのモデルさえ変化しつつある現状では「AIがなぜこの情報を引用するのか」を理解することこそが、企業やブランドの生き残り戦略にとって重要です。

SEOとLLMOの違い

AI時代の情報発信では、評価軸が大幅に変化しました。「どうすればAIに選ばれ、AIがユーザーに推薦してくれるのか?」という従来のSEOだけでは解決できない課題に、改めて向き合う必要があります。

SEOとLLMOの違いを理解することは、今後の情報発信の成果を大きく左右することになるでしょう。

目的・アプローチの違い

SEOは「検索エンジンで上位に表示される」ことが最大のゴールでした。そのため、従来のSEOでは、適切なタイトルや見出しの設定、リンクの最適化など、検索エンジンに認識されやすくするための工夫が重要でした。しかし、LLMOでは主語が「AIそのもの」へと変わります。

AIはコンテンツについて「誰が書き、どのような根拠があり、どのような構造でまとめられているか」まで深く分析する能力を持っています。

「信頼できる内容であること」「引用元やデータが明確であること」「文脈や構成に無駄がないこと」、これらが「AIに選ばれる」コンテンツの絶対条件です。

評価基準の違い

SEOの世界では、順位・流入数・コアウェブバイタルなど、明確な数字で成果を測ることができました。

これに対し、LLMOには「AIに引用された回数」「AI経由の流入数」「ユーザー体験や有用性」など、AI独自の評価軸が加わっています。

AIは膨大な情報の中から「このページを選択しよう」と論理的に判断する能力を持っており、これを攻略することが新しい競争力を左右します。

LLMOの基本的な仕組み

AIが情報をどう読み解き、何を評価基準にしているのかという「仕組み」を理解することが、AI時代のコンテンツづくりの出発点です。

見た目やテクニックではなく、本質を捉えた情報設計がなぜ必要なのかを解説します。

LLMの構築と役割

大規模言語モデル(LLM)は膨大なデータセットで学習されており、「Stanford HAI AI Index Report 2025」によると、LLM訓練用データセットのサイズは8か月ごとに倍増し、訓練計算量は5か月ごとに倍増。

AIは単なるキーワードの羅列や「SEO的な装飾」を重視しません。情報の正確さや論理の流れ、根拠・出典の有無といった「内容の本質」に価値を見出します。

LLMOのプロセスとフロー

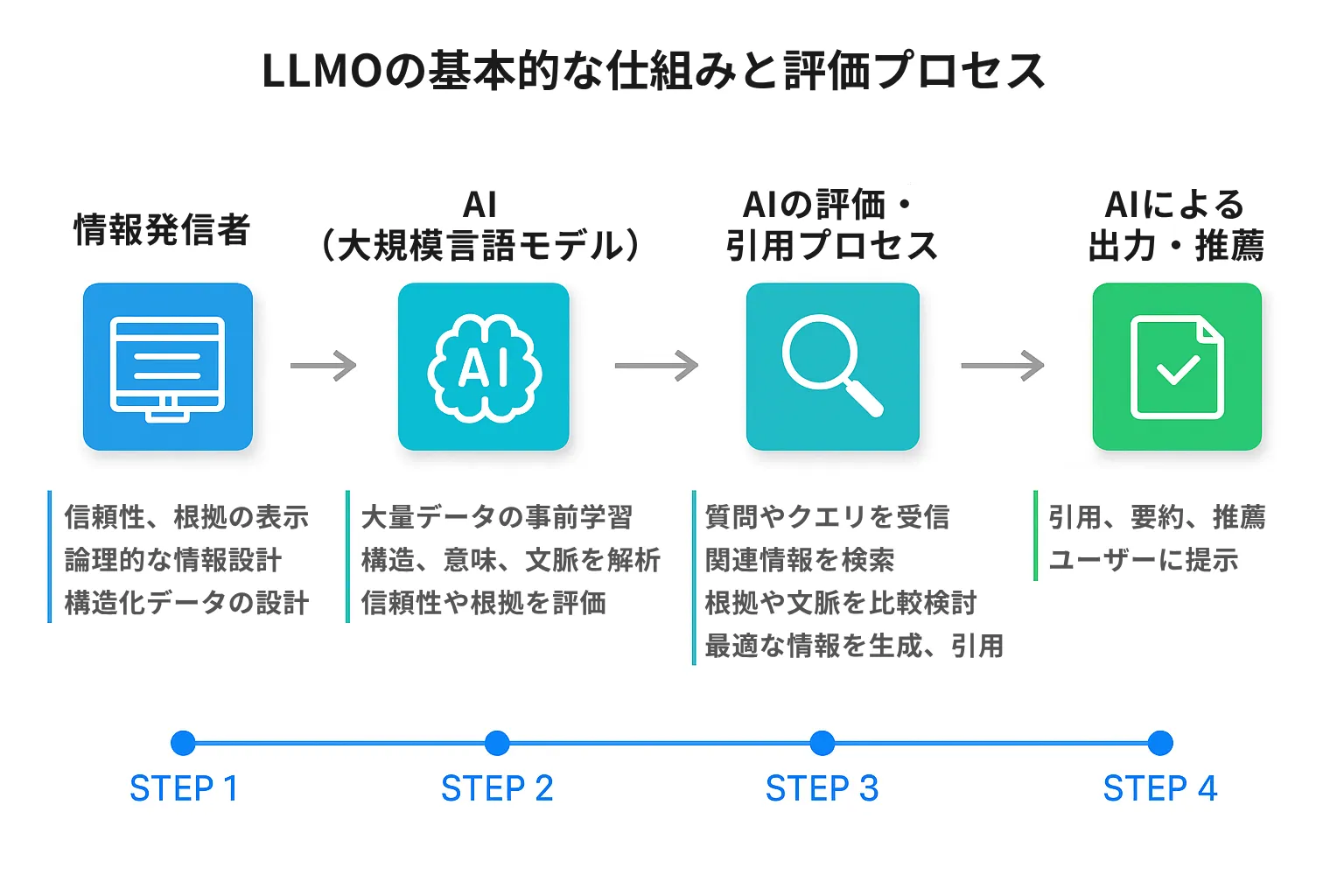

自社サイトや発信情報がAIにとって理解しやすい構造になっているかが、LLMOのスタート地点です。

まず現状を分析し、構造化データを設計・実装することで、AIが情報の意味や階層、関係性を正確に捉えやすくなります。

このプロセスで生まれる「文脈」や「根拠」の積み重ねが、AIによる引用や要約精度に大きく影響を与えるのです。

LLMO対策の具体的手法

理論だけでは、AI時代の情報発信は成功しません。「実際にどのような対策を行えば成果につながるのか?」という現場の疑問に、実装・運用の観点から答えます。

テクニカルSEOとの統合・強化策

AIが情報を正しく取得するには、robots.txtの設定や構造化データが欠かせません。

ここでミスをすると、AIクローラがページの内容を理解できず、どれだけ中身が良くても無視されてしまいます。重要なページがクロール禁止になっていないかrobots.txt内の記述を必ず確認しましょう。

FAQや商品情報、レビューなどはschema.org(AIが理解しやすいルール)やJSON-LD形式(そのルールをページに埋め込む記述方法)で構造化データ化し「AIが”意味”を理解できるように」設計することが重要です。

サイトリニューアル時などはrobots.txtや構造化データの設定抜けが多いため要注意です。

コンテンツ制作におけるLLMO活用

AIが重視するのは、根拠の明示、運営体制の透明性、そしてFAQやブログ記事の充実度など、コンテンツの質に関わる要素です。

著者情報や出典、定期的な情報更新を通じて、AIにもユーザーにも信頼される「軸」を育てます。

解説やデータの根拠として、政府統計や研究論文を必ずリンクや出典で明示しましょう。

運営者情報ページで会社・チーム・責任者の名前・専門分野までしっかり公開することも大切です。

さらに、ユーザーの疑問への回答や業界の最新FAQをページ下部だけでなく本文にも自然に盛り込み、最終更新日や更新履歴を表示して、古い情報が放置されていないことを示すことも効果的です。

ユーザーエクスペリエンス最適化との連携

GoogleのAI OverviewsによってUX(ユーザー体験)が向上することで、検索利用回数やユーザーの満足度がアップすることがわかっています。

このようなAI時代の検索体験に対応するためには、Webサイト自体のUXも最適化する必要があります。

例えば、直感的な操作性やわかりやすいナビゲーションはAIの評価にも直結します。

また、スマホでの使いやすさ(大きなボタン、シンプルな導線)にも配慮し、トップや記事冒頭に目次や「よくある質問」などのリンクを設置しましょう。

専門用語には注釈・図解も添えて、幅広いユーザーが迷わない設計にすることが重要です。

ページの表示スピードもUXの重要な指標となっており、表示が遅いとAIの評価も下がってしまいます。

プライバシー・セキュリティ対策

AIを安全に使うための世界初の包括的な法規制であるEUのAI Actなどを契機に、国際社会はAI時代の情報発信に厳格な基準を設け始めています。

情報漏洩やデータの不適切な取り扱いは、AIからも「危険情報」として自動的に排除される時代となったため、事前のリスク対策が不可欠です。

AIを使った顔認証やユーザーデータ分析では、十分な匿名化やデータ最小化が必須です。

ユーザーに対する「データの使い方」の説明や同意取得を徹底し、社内でもデータ管理ルール・マニュアルを最新化することで、もしもの時に備えることが求められます。

LLMO運用に必要な社内体制とスキル

AI時代の最適化は、一部の担当者だけでは完結しません。現場とマーケティング、エンジニア、外部パートナーが連携する「チーム力」が成果のカギになります。

今、企業に求められる体制づくりや人材育成のポイントを押さえましょう。

「Stanford HAI AI Index Report 2025」によると、2024年の企業のAI利用率は55%から78%に急増しています。

このようにAI導入が加速するなかで、専任のAIガバナンス組織やワークフローの再設計、AIリスキリングに力を入れる企業が増加中です。

部署の垣根を越え、専門性の異なる知見が集まる環境が成果を生み出しています。

具体的には、責任者や専任チームをつくり、全体の方針・チェック体制を統一することで、現場と経営層の情報ギャップを埋めることができます。

企画・制作・チェック・公開までのワークフローをシンプルにして、AIと人の役割分担を明確化しましょう。

また、各部門(マーケ、エンジニア、法務など)が最低限のAI知識を身につけるため、社内勉強会やリスキリングを積極的に推進することも重要です。

必要に応じて外部コンサルタントや専門家を招いてノウハウを獲得し、継続的に内部へ落とし込む仕組みをつくることが求められます。

LLMOの効果測定と改善

検索順位やPVだけでなく、新しい評価軸を設定し「何が効果につながったか」を把握することが不可欠です。

定量的な効果測定方法

AI Overviews(AIOV)の導入により、検索体験そのものが大きく変化しています。

ユーザーは検索結果ページで直接情報を得る機会が増え、Googleにとっては検索利用回数の増加といった成果が現れています。

しかし、個別のWebサイトにとっては、クリックされずに情報が消費される「ゼロクリック検索」が増加傾向にあり、従来のクリック数やページビュー(PV)だけでは効果を正確に評価しづらくなってきました。

こうした変化を受け、以下のような新たなKPI(重要業績評価指標)を導入する企業が増えています。

・AIからの引用回数

・AI経由のCVR(成約率)

・エンゲージメント(平均滞在時間など)

ただし、「AI経由の成果」がどの程度把握できるかは、利用されるAIプラットフォームによって異なります。

例えば、ChatGPTやGeminiなど一部の生成AI経由であれば、アクセス解析ツールを通じて訪問元をある程度確認できる場合があります。

また、GoogleのAI Overviewsについては、2025年7月時点でも「どの訪問がAI経由なのか」をGoogle Search Consoleなどで明確に判別することはできません。

このため、AIOVによる間接的な効果を把握するには、FAQの表示回数やリッチリザルトの掲載状況、特定コンテンツの動向などを総合的に観察しながら評価していくことが求められます。

引き続き、AIに取り上げられやすい情報設計と、柔軟な指標設定がカギとなります。

定性的な評価・ユーザー調査

現代は、数字だけでなく「ユーザーの声」もAIに評価される時代です。ユーザー満足度や現場のリアルな意見がAIの判断材料としても活用されています。

そこで、サイトやサービス利用者にアンケートを送ったり、ページの満足度を判定するボタンを設置したりして「どの情報が役立ったか」「改善要望は?」など、ユーザーの声を集めましょう。

レビューやコメント、ユーザーからのフィードバックを定期的に整理・分析し、コンテンツやサイトの改良に反映させることが効果的です。

また、チャットボットなどを通じて集まる質問や感想をデータ化し、「よくある困りごと」や「説明不足だった点」を抽出することも有用です。

こうして得られた内容をもとに、FAQ(よくある質問)などの情報を定期的に更新・補強することで、ユーザーの疑問や不安に先回りして応える体制が整います。

よくある誤解・失敗例/成功へのポイント

LLMO(大規模言語モデルの最適化)を成功させるためには、監視体制と定期的な改善の仕組みを整え、ブランドやユーザーからの信頼を守ることが欠かせません。

よくある失敗の一つが、古い情報や誤ったデータを放置したために、AIにそれを引用されてしまうケースです。

こうした誤情報を信じたユーザーに迷惑がかかるだけでなく、「誤った情報を発信している企業」としてブランドの信頼を大きく損なう可能性があります。

また、セキュリティ対策が不十分なサイトがウイルスに感染すると、情報漏えいにつながる危険性もあります。

また、一度つくったFAQや記事を長期間更新しないままでいると、AIに「価値が低い」と見なされる場合もあります。

LLMOを成功につなげるには、正しさ・新しさを定期的に点検し、必要があればすぐ修正する仕組みを構築することが重要です。

誤情報対策やセキュリティのルールを全社で共有し、トラブル発生時は迅速に情報開示および改善を行いましょう。

「見直す・守る・改善する」のサイクルを常に回し続けることが何より重要です。

LLMO導入のステップ・診断チェックリスト

LLMO(大規模言語モデルの最適化)は、いきなり大きな施策に取りかかる必要はありません。

まずは現状を見直し、改善すべき点と活用できる強みを整理することが第一歩です。段階的に進めることで、自社にとって有効なAI活用が見えてきます。

現状分析・目標設定

AI導入の競争が激化するなか、自社の現状を正しく把握し、目標やKPIを適切に設定することが重要です。

-

- まず、サイト構造やコンテンツがAIにとって扱いやすいものであるかを確認します(例えば、見出し構成が整理されているか、要点が簡潔に整理されているか)

-

- 流入数・CVR・ユーザー満足度など、現状のKPIを数値で明示しましょう。

AI Overviewsにおける自社サイトの引用状況については、キーワードごとに検索結果をチェックできる外部ツールを使うことで、ある程度の把握が可能です。

例えば、SE Ranking や ZipTie などでは、特定キーワードに対してAI Overviewsが表示されているかどうか、どのドメインが引用されているかどうかを確認できます。

ただし、引用回数や表示頻度などの定量的なデータは取得できない点に留意が必要です。

一方、Google Search Console では AI Overviews経由の流入を識別することができません。

また、ChatGPT や Gemini など一部の生成AIからの流入はアクセスログで認識できる場合もありますが、AIOVについては現在は識別不可です。

ターゲットAI/ツールの選定

Google AI OverviewsやAI検索など、狙うべきAIプラットフォームを明確にし、リソースを集中することで成果が最大化します。

どのAIプラットフォームで情報がよく引用されているかを、実績や公式データから確認しましょう。

AI OverviewsでFAQがよく取り上げられているならFAQ強化に注力し、ChatGPTやGeminiなど、無料・低コストのAIでの自社情報の扱われ方をまずテストし、効果を見極めてからLLMOの本格導入に進むと効率的です。

実施計画とリスク対策

法令遵守やリスク管理はLLMOでも必須条件です。EU AI Actに準拠し、専門家と協力しながら計画を策定しましょう。

特に、法律やガイドラインの最新動向を、法務部門や外部専門家と定期的に確認することが重要です。

データの収集や活用、AIに引用されやすくするための情報整備(コンテンツの最適化)にあたっては、その範囲や匿名化ルールを社内で明文化し、トラブル発生時の連絡フローや責任体制も事前に整備しておく必要があります。

LLMO導入診断チェックリスト

自社の現状を把握するため、以下の5つの分野をチェックしてみましょう。

1. AI活用状況

・社内でChatGPTや生成AIを使った実績はありますか?

・どの部署で、どのような業務に活用していますか?

2. 構造化データ対応

・重要なページ(商品紹介、FAQ、会社情報など)に構造化データを設定済みですか?

・schema.orgやJSON-LD形式での実装は完了していますか?

3. KPI設計

・AI経由の流入数やFAQ引用数など、新しい指標を測定していますか?

・従来のSEO指標以外に、AI時代に適した成果指標を設定していますか?

※なお、ChatGPTやGeminiなどの一部の生成AIからの流入はアクセス元を識別できるケースがありますが、GoogleのAI Overviews経由の流入は通常の検索流入と区別できないため、測定には限界があります。

4. 人材体制

・AI推進の責任者や担当チームは決まっていますか?

・各部門にAIの基本知識を持った人材はいますか?

5. 法令遵守

・EUのAI Actなど、最新の法規制に対応する運用ルールはありますか?

・データ管理や個人情報保護の体制は整っていますか?

これらの項目をチェックすることで、自社の課題と改善すべき優先順位が見えてきます。

LLMOのメリット・デメリット

LLMOは成果を出せば大きな武器になりますが、落とし穴やリスクも存在します。

メリットとデメリットの両面を理解し、現場での失敗を避けることが大切です。

LLMO導入のメリット

LLMO導入のメリットは、AI経由の新規流入や指名検索が増え、SEOだけでは届かない層にリーチできることです。

コンバージョン率(成約・問い合わせ・資料請求など)がアップするケースも多数報告されています。

具体的には、社内資料や情報を「AIに見やすく設計」すること、つまりAIが検索・処理しやすい形式で整理・作成することが重要です。

競合よりも早くAIフレンドリーなサイトに転換することで、ブランドの信頼やPR効果も強化されるでしょう。また、同時に業務効率や社員満足度の向上にもつながります。

LLMOのデメリット・課題

AIが要約を返すことで「直接ページを見に来る人が減った」という現象も実際に発生しています。

そのため、広告収入やPV重視型のビジネスでは、AI経由で流入する仕組みを新たに検討する必要があります。

LLMOはルールや評価軸が変化しやすいため「一度やったら終わり」ではなく、継続した運用改善・体制強化が必須です。

LLMOの未来展望とトレンド

AIと情報発信の領域は、2025年以降さらに大きく進化します。技術の進化とともに、情報がAIによって「どう扱われるか」が、企業の信頼・認知・成果に直結する時代が本格化しています。

今後のトレンド・予測

AIが判断・提案・実行までを担うAgentic AI(自律型AI)の発展により、「AIとの対話」だけでなく「AIによる判断」がユーザー体験に深く組み込まれるようになります。

これに伴い、AIガバナンスや偽情報対策も重要な潮流となり、安全で信頼性の高い情報提供が今まで以上に求められます。

LLMOがもたらす新たな機会・ビジネスの可能性

AIが情報の入口となる今、企業のブランドやメッセージが「AIに見つけられ、正しく引用される」ことが大きな競争優位性になります。

例えば、以下のような場面でユーザーの接点が広がっています。

- AIの回答画面(ChatGPT、Google AI Overviews など)

- 検索サジェスト

- SNSやフォーラム

- ストリーミングプラットフォームの説明欄 など

これまでのように「公式サイトに来てもらう」だけでなく、「情報がどこでAIに拾われ、どう表示されるか」を設計することが、今後の情報発信の要となります。

UGC(ユーザー生成コンテンツ)やレビューといった実体験ベースの情報がAI回答に使われる場面も増えており、LLMOの観点からも「誰がどこで発信するか」の設計がますます重要です。

LLMOを活用した効果的なWeb戦略

LLMOはもはや一過性のトレンドではなく、AI時代の「情報発信の新たな基準」です。

2024年時点でAI活用企業はすでに全体の78%に達しており、対応のスピードと質が企業成長を左右し始めています。

これからの成功には、以下の4つを柱とするLLMOの継続的な運用が不可欠です。

- 情報の構造化

- ユーザー体験の徹底

- 法令遵守とリスク管理

- 人材育成と体制整備

「AIにも人にも信頼される情報発信」を実現するには、現場の工夫と部門横断のチーム力がカギとなります。

常にアップデートを重ねながら、LLMOを自社のWeb戦略の中核に据えることが、これからの成長を支える最も確かなエンジンとなるでしょう。

FAQ|よくある質問と回答

LLMOの導入を検討する際によく寄せられる質問をまとめました。実際の取り組みを始める前に、疑問点を解決しておきましょう。

Q:LLMOでAIに「選ばれる」コンテンツとは?

A:AIに選ばれるためには、公式データの引用や監修者・運営組織の明示、定期的なFAQ・Q&A追加が効果的です。

Q:LLMO対策で最初にやるべきことは?

A:AIに正しく情報を理解・評価してもらうには、まず「構造」と「信頼性」を整えることが基本となります。以下の対策から優先的に取り組みましょう。

-

- 重要ページ

-

- FAQ

-

- レビュー等の構造化データ実装

公式・専門機関のデータを数値などの情報は出典付きで明記することに加え、著者・会社情報をしっかり公開し、運営体制の透明性を示すことが重要です。

Q:AI Overviews流入を増やすポイントは?

A:FAQ形式や「問いと答え」を本文やページ内にちりばめ、出典や最終更新日も明記しましょう。AI Overviewsで実際に取り上げられた事例ページを参考に、自社FAQ・コンテンツを強化することが効果的です。

Q:LLMOの成果をどうやって数字で測る?

A:LLMOの効果は、従来のSEO指標に加え、AI経由の反応や引用状況を把握することで「見える化」できます。次のような指標を定期的に計測し、改善サイクルを構築しましょう。

-

- AI経由のクリック数

-

- 流入数(Google Search Console等で確認)

-

- AIからの引用回数

-

- AI経由の成約・エンゲージメント

-

- FAQやリッチリザルトの表示回数

Q:チーム・体制で重要なことは?

A:AI推進責任者や専任チームを置き、経営層と現場が一体となって情報共有・課題改善する体制をつくりましょう。外部の専門家やコンサルタントも柔軟に活用することが大切です。

Q:法律やリスク対策のポイントは?

A:EUのAI Actなど、世界基準のルールに準拠し、情報管理やAI利用における社内ルールを整備することが必須です。特に以下の観点での整理と明文化が重要です。

-

- ユーザーが入力する問い合わせ内容やフィードバック(個人情報やセンシティブ情報を含む可能性)

-

- FAQやコンテンツをAIが参照する際の情報構造と利用方針

-

- 意思決定過程や自動化された提示内容の透明性

これらを整理したうえで、データの収集・利用・匿名化ルールを定め、万が一トラブルが起きた際には法務や専門家と密に連携できる体制を整えておくことが重要です。

【出典】

Stanford HAI AI Index Report 2025

Search Engine Land Google AI Overviews expand to more users

https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai